La inteligencia artificial se ha vuelto accesible para todos. Hoy cualquier empleado puede abrir una herramienta gratuita en su navegador y, en cuestión de segundos, generar informes, analizar datos o redactar propuestas. El problema no es la tecnología en sí. El problema es cuando se utiliza sin control dentro de la empresa.

A este fenómeno se le conoce como Shadow AI: el uso de herramientas de inteligencia artificial no autorizadas por el departamento de tecnología o seguridad. Es similar al antiguo “Shadow IT”, pero con un nivel de riesgo mucho mayor debido a la sensibilidad de la información que se introduce en estos sistemas.

El escenario es más común de lo que parece. Un comercial copia datos de clientes en una herramienta online para que le ayude a redactar una propuesta. Un analista financiero sube cifras internas para que le generen un resumen ejecutivo. Un empleado de recursos humanos introduce información contractual para redactar un comunicado. Todo parece inofensivo. Pero esos datos pueden quedar almacenados en servidores externos, fuera del control de la empresa.

El riesgo no está solo en la filtración directa, sino en la pérdida de trazabilidad. Cuando la organización no sabe qué información se está compartiendo ni con qué plataformas, pierde control sobre su activo más valioso: los datos.

Las principales amenazas del Shadow AI pueden resumirse así:

| Riesgo | Descripción | Impacto Potencial |

|---|---|---|

| Fuga de datos confidenciales | Información sensible subida a plataformas externas | Daño reputacional y sanciones legales |

| Incumplimiento normativo | Violación de leyes de protección de datos | Multas y responsabilidad legal |

| Pérdida de propiedad intelectual | Estrategias o documentos internos expuestos | Ventaja competitiva comprometida |

| Falta de control y auditoría | No existe registro interno del uso de herramientas | Dificultad para gestionar incidentes |

| Dependencia de plataformas no verificadas | Uso de servicios sin evaluación de seguridad | Riesgo tecnológico y operativo |

Uno de los mayores errores es pensar que el riesgo proviene de empleados malintencionados. En la mayoría de los casos, ocurre lo contrario. Los trabajadores buscan ser más productivos. Quieren ahorrar tiempo y mejorar resultados. El problema surge cuando la cultura de la empresa no ofrece alternativas oficiales seguras.

Prohibir no suele ser la solución. La tecnología avanza más rápido que las políticas internas. Si la empresa no proporciona herramientas aprobadas y formación clara, el uso informal seguirá creciendo.

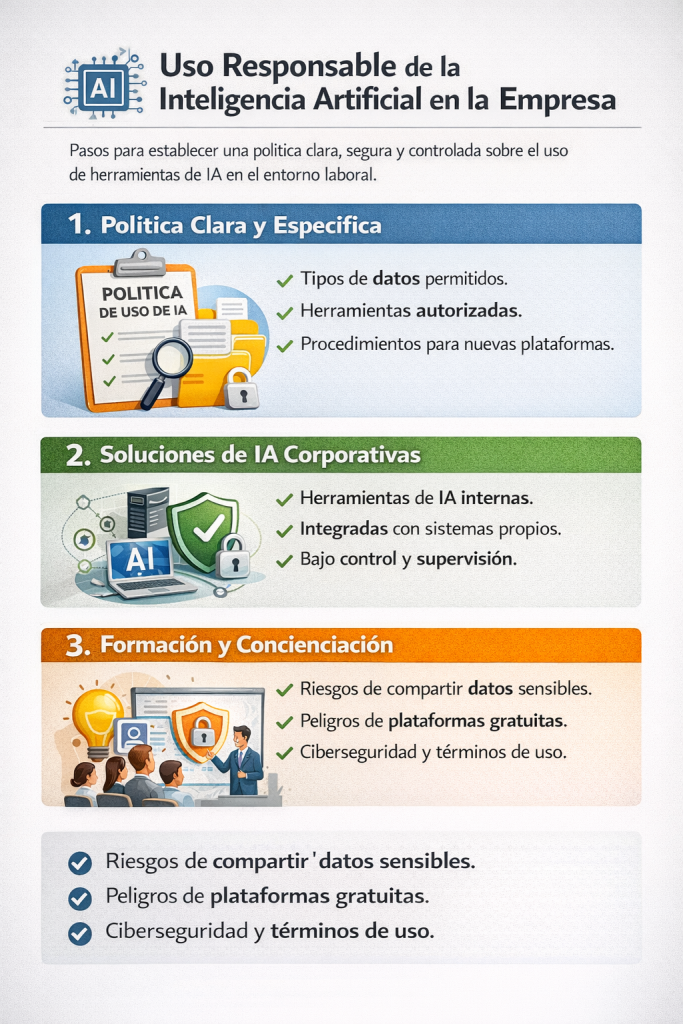

La respuesta estratégica pasa por tres pilares.

Primero, establecer una política clara de uso de inteligencia artificial. No basta con un documento genérico. Debe especificar qué tipo de datos pueden compartirse, qué herramientas están autorizadas y qué procedimientos seguir antes de utilizar nuevas plataformas.

Segundo, ofrecer soluciones corporativas seguras. Si la organización implementa herramientas de IA integradas con sus sistemas y bajo su propio control, reducirá la necesidad de que los empleados busquen alternativas externas.

Tercero, formar y concienciar. Muchos trabajadores desconocen que al introducir datos en plataformas gratuitas pueden estar aceptando términos que permiten el almacenamiento o uso de esa información para entrenar modelos. La educación en ciberseguridad ya no es opcional.

También es clave involucrar al departamento legal y de cumplimiento normativo. En sectores regulados, una filtración accidental puede traducirse en sanciones millonarias.

El Shadow AI no es un problema tecnológico; es un problema de gobernanza. Refleja una desconexión entre la velocidad de innovación y la capacidad de control interno.

La inteligencia artificial puede generar enormes ventajas competitivas, pero solo cuando se integra dentro de una estrategia clara y segura. Permitir que cada empleado utilice herramientas externas con datos confidenciales es delegar el control del riesgo a la improvisación.

En un entorno donde la información es poder, proteger los datos no es una cuestión técnica, sino una decisión estratégica. La verdadera amenaza no es que los empleados usen inteligencia artificial. Es que lo hagan sin que la empresa lo sepa.